Miért hívják a webes robotokat pókoknak? A webindexelés technológiájának megértése

Tudja meg, miért nevezik a webes robotokat pókoknak, hogyan működnek, és milyen kritikus szerepet töltenek be a keresőmotorok indexelésében. Fedezze fel a webes...

Tudja meg, miért hívják a webes robotokat számítógépes pókoknak, és hogyan járják be az internetet. Ismerje meg, hogyan működnek a keresőmotorok robotjai, és miért fontosak a SEO és az affiliate marketing szempontjából.

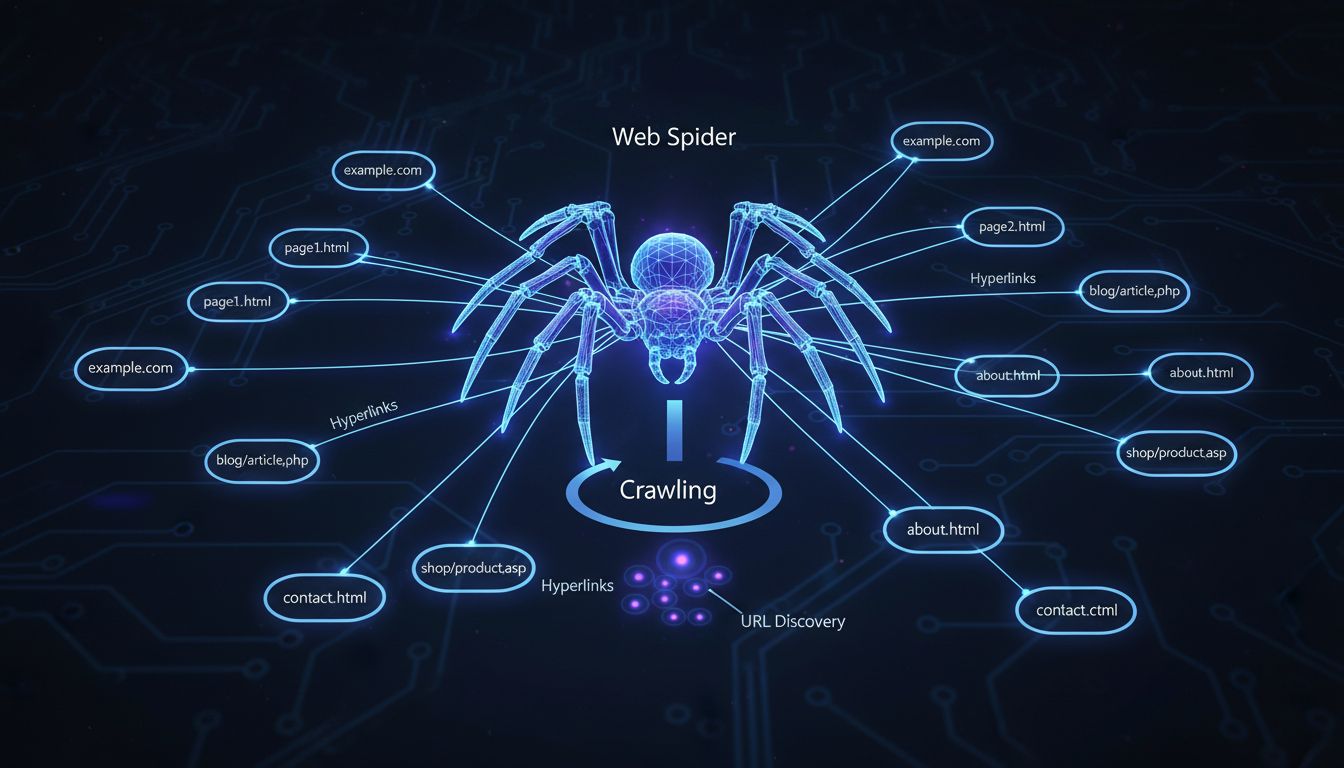

A webes robotokat azért nevezik számítógépes pókoknak, mert "bejárják" az internetet, követve a hivatkozásokat egyik oldalról a másikra, hasonlóan ahhoz, ahogy egy pók mozog a hálóján. Ezek az automatizált programok rendszerszerűen fedezik fel a weboldalakat, hogy tartalmukat feltérképezzék és indexeljék a keresőmotorok számára.

A “számítógépes pók” kifejezés egy találó analógiából ered, amely tökéletesen leírja, hogyan működnek ezek az automatizált programok az interneten. Ahogyan egy igazi pók mozog a hálóján, követve a szálakat és kapcsolatokat, úgy egy webes pók is a hivatkozásokat követve navigál egyik weboldalról a másikra. Ez a metafora annyira magától értetődővé vált, hogy ma már világszerte ezt a terminológiát használják a webfejlesztők, SEO szakemberek és digitális marketingesek. Az elnevezés tökéletesen megragadja a keresőrobotok viselkedésének lényegét, így technikai és nem technikai közönség számára is azonnal érthető. Ha megérti ezt az alapvető koncepciót, jobban átlátja, mennyire elegánsan tükrözi az internet infrastruktúrája a természetben található rendszereket.

A webes pókok egy szisztematikus és módszeres folyamatot követnek, amely egy ismert URL-eket tartalmazó kezdőlistával indul. A keresőrobot először ezeket a weboldalakat látogatja meg, majd alaposan elemzi azok tartalmát és szerkezetét. Miközben feldolgoz minden oldalt, a pók azonosítja a rajta található összes hivatkozást, és hozzáadja azokat a következőként meglátogatandó URL-ek sorához. Ez a folyamat folyamatosan ismétlődik, lehetővé téve, hogy a pók minden egyes lépéssel egyre mélyebbre hatoljon a weben. A pók lényegében az internet térképét készíti el, követve ezeket a kapcsolatokat, mint egy felfedező, aki új területeket térképez fel ösvényeket és nyomokat követve. Ez a rendszeres megközelítés biztosítja, hogy a keresőmotorok minden nap több millió új oldalt fedezhessenek fel és katalogizálhassanak.

| Keresőrobot alkotóelem | Funkció | Cél |

|---|---|---|

| URL-sor | A meglátogatandó oldalak listáját tárolja | A feltérképezési sorrend szervezése |

| Parser | Feldolgozza az oldal tartalmát és HTML-jét | Hivatkozások és metaadatok kinyerése |

| Indexelő | Elmenti az oldal információit | Kereshető adatbázis létrehozása |

| Ütemező | Meghatározza a feltérképezés gyakoriságát | Az erőforrások elosztásának kezelése |

| User-Agent | Azonosítja a keresőrobotot | Kommunikáció a szerverekkel |

Mielőtt egy webes pók megkezdené a feltérképezést, a fejlesztőknek világos, előre meghatározott utasításokat kell létrehozniuk, amelyek irányítják a pók viselkedését. Ezek az utasítások határozzák meg, mely oldalakat kell feltérképezni, milyen gyakran kell újra meglátogatni az oldalakat, és milyen információkat kell kinyerni minden oldalon. A keresőrobot ezután automatikusan végrehajtja ezeket az utasításokat, pontosan követve az algoritmust. Amikor a pók meglátogat egy weboldalt, először ellenőrzi a robots.txt fájlt, amely egy szöveges fájl, amely a keresőrobotok hozzáférési szabályait tartalmazza. Ezt a protokollt robot kizárási protokollnak nevezik, és lehetővé teszi a weboldaltulajdonosok számára, hogy közöljék preferenciáikat arról, a weboldaluk mely részeit szabad feltérképezni és melyeket nem. A keresőrobot által összegyűjtött információk teljes mértékben a megadott utasításoktól függenek, ezért a beállítási fázis kulcsfontosságú a kívánt eredmények eléréséhez.

A webes pókok többféle formában léteznek, mindegyiket egyedi célokra és alkalmazásokra tervezték. A keresőmotorok robotjai, például a Googlebot, a legismertebbek, amelyeket a nagy keresőmotorok használnak weboldalak felfedezésére és indexelésére a keresési eredményekhez. A fókuszált keresőrobotok ezzel szemben csak bizonyos témákra vagy az internet meghatározott területeire koncentrálnak, részletes indexet készítve speciális tartalmakról. A webes elemző robotok segítenek a webmestereknek saját oldalaik monitorozásában, például a látogatottság, hibás hivatkozások és oldal-teljesítmény nyomon követésével. Az árösszehasonlító robotok automatikusan gyűjtik az árakat különböző kereskedőktől, így az összehasonlító oldalak aktuális piaci adatokat tudnak nyújtani a felhasználóknak. Az e-mail ellenőrző robotok igazolják az e-mail címeket és ellenőrzik a kézbesíthetőséget. Mindegyik pók egyedi szerepet tölt be a digitális ökoszisztémában, és ezen különbségek megértése segítheti a weboldaltulajdonosokat abban, hogy oldalaikat megfelelően optimalizálják az adott keresőrobotok számára.

A keresőmotorok nem tudnának működni webes pókok nélkül, mivel ezek az automatizált programok felelősek az új tartalmak felfedezéséért és a keresési indexek naprakészen tartásáért. Amikor keresést indít, a keresőmotor valójában nem a valós idejű interneten keres, hanem egy olyan indexben, amelyet korábban a webes pókok látogattak meg és katalogizáltak több milliárd weboldalból. Pókok nélkül a keresőmotorok nem tudnák, milyen tartalmak léteznek az interneten, vagy hogyan szervezzék meg azokat a visszakereséshez. A pók azon képessége, hogy követi a hivatkozásokat, azt jelenti, hogy az új oldalak automatikusan felfedezhetők, manuális beküldés nélkül. Ez az automatizált felfedezési folyamat teszi lehetővé, hogy az internet kereshető és elérhető legyen világszerte több milliárd felhasználó számára. A webes pókok hatékonysága és gyorsasága közvetlenül befolyásolja, hogy az új tartalom milyen gyorsan jelenik meg a keresési eredmények között.

A weboldaltulajdonosok és digitális marketingesek számára a webes pókok megértése elengedhetetlen, hiszen ezek a keresőrobotok döntik el, hogy tartalma megjelenik-e a keresési találatok között. Ha egy keresőmotor pókja nem tudja feltérképezni az oldalát, akkor az oldalak nem kerülnek indexelésre, és nem jelennek meg a keresési eredmények között, függetlenül attól, mennyire jó minőségű a tartalmuk. Ezért a SEO szakemberek nagy hangsúlyt fektetnek arra, hogy a weboldalak “robotbarátok” legyenek: megfelelő oldalszerkezet, gyors betöltési idő és átlátható navigáció. Az affiliate marketingesek számára különösen fontos a pók viselkedésének ismerete, hiszen ez közvetlenül befolyásolja, hogy affiliate oldalaikat hogyan fedezik fel és rangsorolják. A PostAffiliatePro felismeri, hogy a sikeres affiliate programok kulcsa a láthatóság, és platformunk segít optimalizálni affiliate hálózatát, hogy a keresőmotorok robotjai könnyen megtalálják és indexeljék affiliate tartalmait. Azáltal, hogy affiliate oldalait elérhetővé teszi a keresőrobotok számára, növeli annak esélyét, hogy potenciális partnerek és ügyfelek organikus keresés útján rátaláljanak programjára.

A weboldal-tulajdonosok számos eszközzel rendelkeznek, hogy szabályozzák, miként lépnek kapcsolatba a webes pókok oldalaikkal. A robots.txt fájl az elsődleges mechanizmus a keresőrobotok felé irányuló preferenciák kommunikálására: lehetővé teszi, hogy meghatározza, mely oldalakat lehet feltérképezni, és melyeket kell tiltani. A noindex meta tag további kontrollt biztosít, mivel megakadályozza, hogy bizonyos oldalak indexelésre kerüljenek, még akkor is, ha azokat a robotok feltérképezik. Azokhoz az oldalakhoz, amelyeket fel lehet térképezni, de nem szeretne indexeltetni, a nofollow attribútum használható a hivatkozásokon, hogy megakadályozza a pókokat az adott kapcsolatok követésében. A weboldal-tulajdonosok a Google Search Console-t és más webmester eszközöket is használhatnak a keresőrobotok aktivitásának nyomon követésére, és az esetleges indexelési problémák azonosítására. Fontos azonban megjegyezni, hogy míg ezek az eszközök segítenek a legitim keresőmotorok robotjainak kezelésében, a rosszindulatú botok és adatgyűjtők gyakran figyelmen kívül hagyják ezeket az utasításokat. Éppen ezért sok weboldal további biztonsági intézkedéseket és botkezelő rendszereket alkalmaz, hogy megvédje magát a káros robottevékenységtől, miközben továbbra is lehetővé teszi a hasznos pókok számára a tartalom elérését.

Bár a webes pókok és az adatgyűjtők (scraperek) egyaránt automatikusan gyűjtenek adatokat weboldalakról, céljaik és etikai működésük jelentősen eltér. A webes pókok – különösen a keresőmotorok által használtak – követik a robots.txt protokollt, és tiszteletben tartják a weboldaltulajdonosok preferenciáit a feltérképezhető tartalom tekintetében. Az adatgyűjtők ezzel szemben gyakran figyelmen kívül hagyják ezeket az utasításokat, és akár teljes oldalakat másolnak át újraközlés céljából, ami szerzői jogsértést és szellemi tulajdon elleni jogsértést jelenthet. A pókok általában csak metaadatokat gyűjtenek és szerveznek az oldalakról, míg az adatgyűjtők a teljes látható tartalmat lemásolják. A keresőrobotokat általában hasznosnak tartják, mivel elősegítik a weboldalak láthatóságát, míg az adatgyűjtőket általában károsnak tekintik, mert tartalmat lopnak, és ronthatják a weboldal teljesítményét. Ennek a különbségnek a megértése fontos a weboldal-tulajdonosok számára, akiknek különbséget kell tenniük a legitim keresőrobot-forgalom és a káros bottevékenység között. A PostAffiliatePro segíti az affiliate menedzsereket az affiliate oldalaik forgalmának monitorozásában és kezelésében, biztosítva, hogy a legitim pókok hozzáférhessenek tartalmaikhoz, miközben védelmet nyújtanak a rosszindulatú adatgyűjtőkkel szemben.

Ahogyan a webes pókok felfedezik és indexelik a tartalmait, a PostAffiliatePro segít felfedezni és kezelni a teljes affiliate hálózatát. Kövesse nyomon a robotok minden interakcióját, és optimalizálja affiliate programja teljesítményét iparágvezető platformunkkal.

Tudja meg, miért nevezik a webes robotokat pókoknak, hogyan működnek, és milyen kritikus szerepet töltenek be a keresőmotorok indexelésében. Fedezze fel a webes...

A pókok olyan botok, amelyeket spam küldésére hoztak létre, és komoly problémákat okozhatnak a vállalkozásodnak. Tudj meg többet róluk a cikkből.

A robotok (crawlers) adatokat és információkat gyűjtenek az internetről weboldalak meglátogatásával és az oldalak tartalmának olvasásával. Tudjon meg többet ról...